- 文●ハッチ

NVIDIAは、都内・某所にて「RTX AI PC メディア向け説明会&デモ体験会」を実施した。本説明会では、1月6日より米・ラスベガスで行われたCES2026にて、同社が発表したばかりの最新AIテクノロジを取り入れたゲーミングデモや、AI愛好家の日常の生産性を向上し、制作活動を高速化する最新のAIモデルを活用したRTX AI PCのデモが見られた。

説明会では、NVIDIAのテクニカルマーケティング マネージャー澤井理紀氏が、説明を行った。

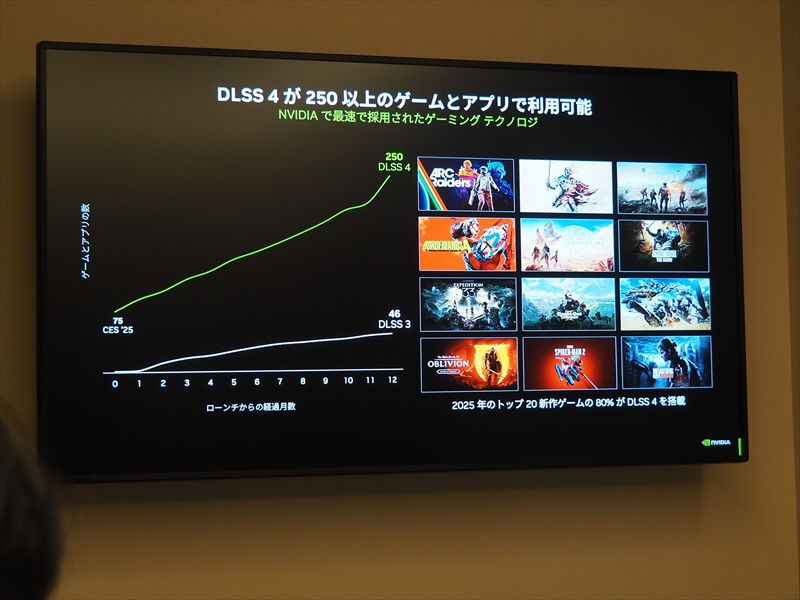

DLSS 4対応タイトルは250以上、今後の期待作でも採用予定

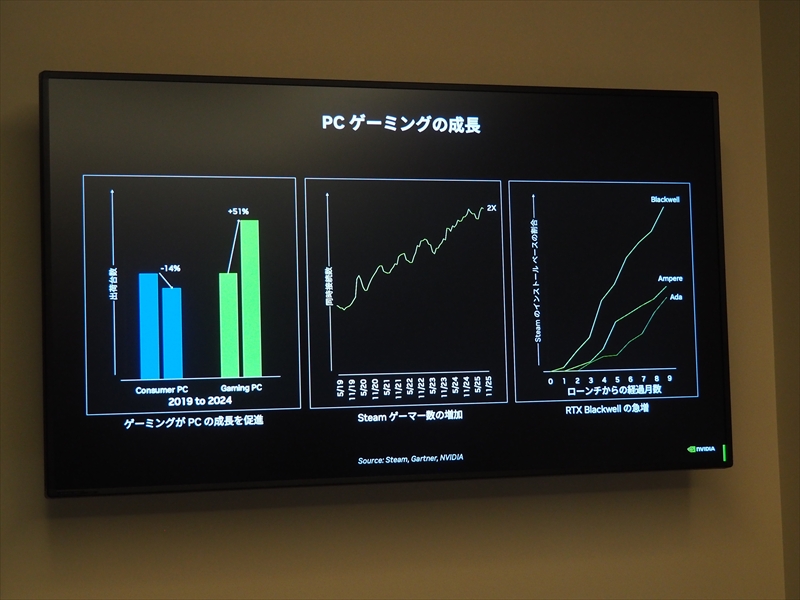

CES2026でも紹介されたとおり、Blackwellアーキテクチャの「GeForce RTX 50」シリーズのGPUを使用したユーザーは、とても増加している。

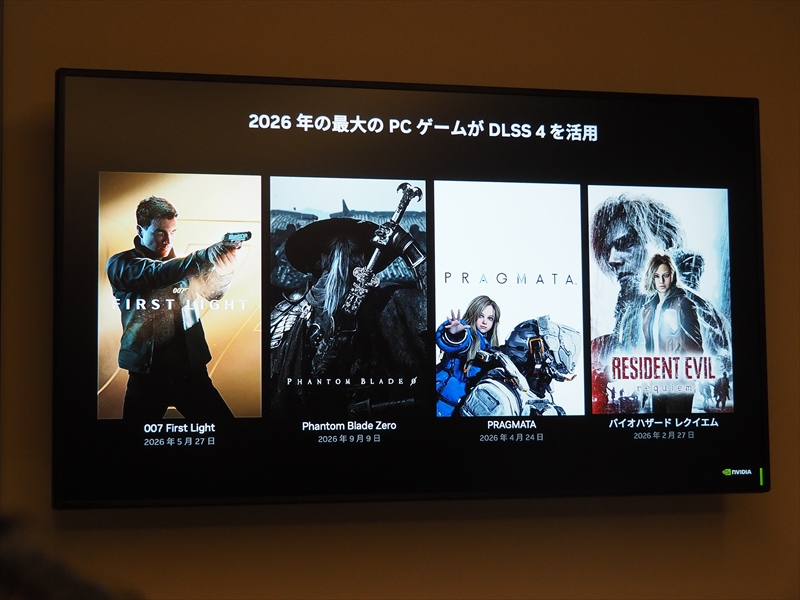

また、既存のDLSS 4は250以上のPCゲームで使用され、2025年の人気トップ20のゲームの80%がDLSS 4を採用している。2026年も『007 First Light』や『Phantom Blade Zero』、『PRAGMATA』、『バイオハザード レクイエム』といった最新タイトルで採用される予定としている。

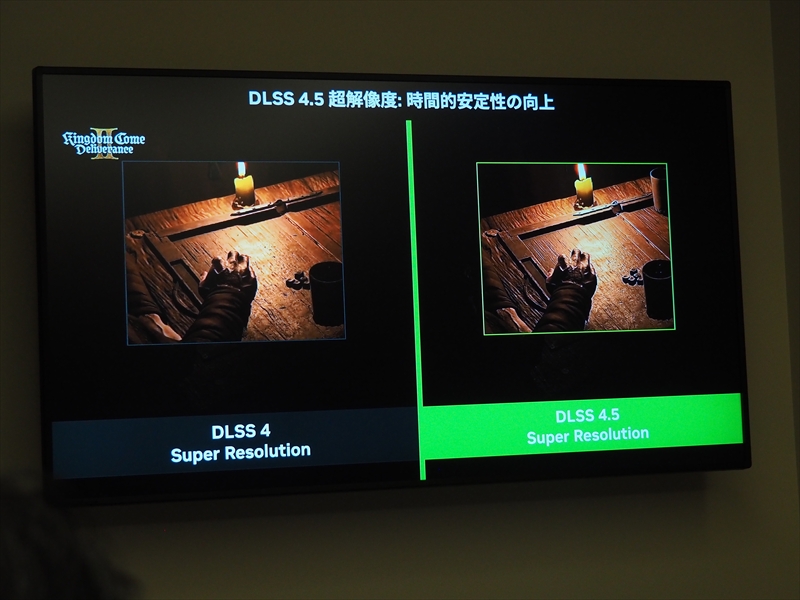

新たなDLSS 4.5は、従来よりもさらに映像が鮮明に

新しいDLSS 4.5は、従来のTransfomerモデルよりも最大5倍の計算力がある、第2世代のTransformerモデルを採用。これにより、DLSS4よりも画質が向上する。

第2世代Transformerモデルは、FP8アクセラレーション対応の検査コアを搭載しているGeForce RTX 40シリーズ、そしてRTX 50シリーズであれば利用できる。それにより、ゲームのシーン全体をより深く理解し、ピクセルサンプリングやモーションベクターといったゲームエンジンのデータを賢く活用して処理し、ライティングのリアリティ、エッジの緻密さ、動く物体の鮮明さが一層向上している。

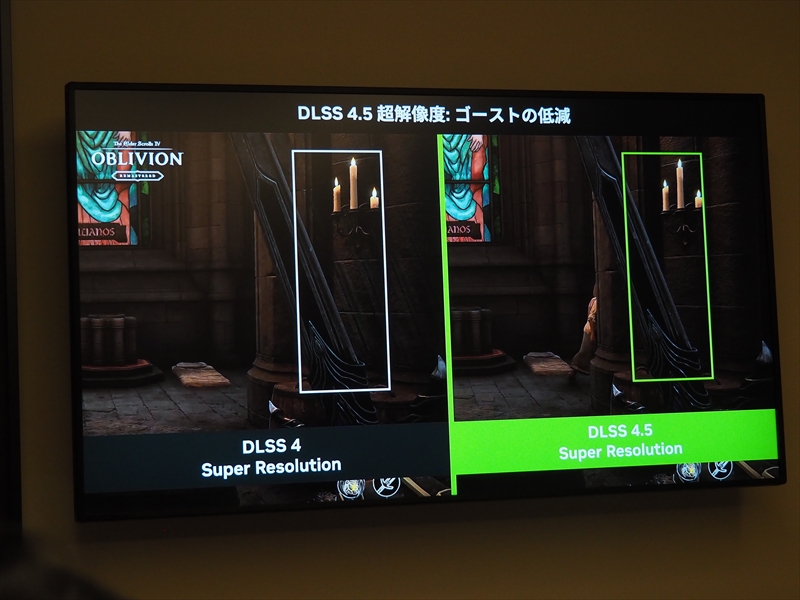

実際に『Kingdom Come: Deliverance II』の映像で比較すると、テーブルの上の映像のちらつきが解消し、より安定した映像を保っているという。また、『The Elder Scrolls IV: Oblivion Remastered』では、従来は動きが速いシーンだとゴーストが発生しているが、DLSS 4.5では非常に滑らかで、エッジが鮮明になっているとのこと。

マルチフレーム生成は4倍から6倍に向上!

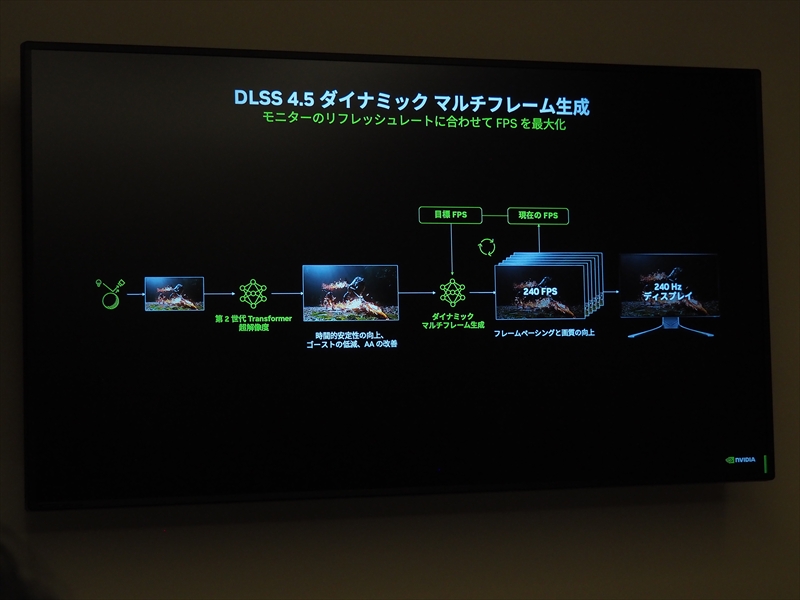

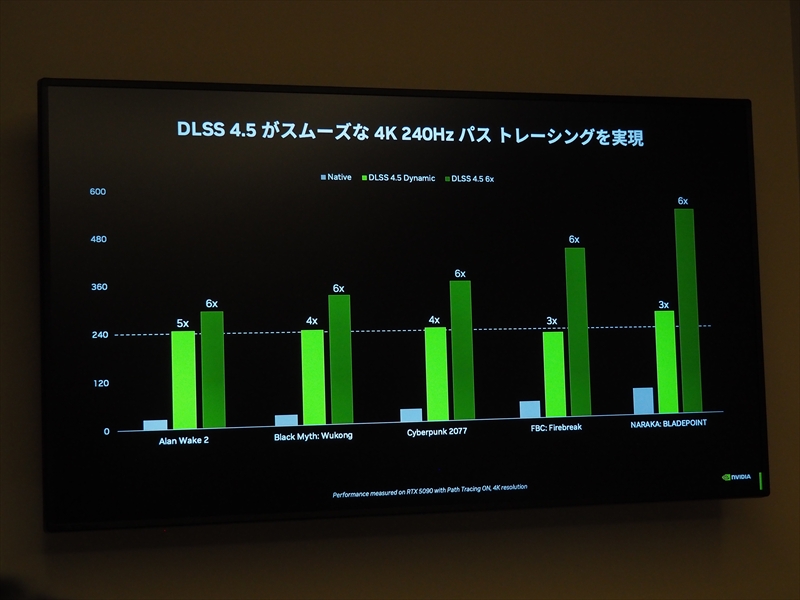

さらに、マルチフレーム生成はDLSS 4では、4倍のマルチフレーム生成に対応していたが、DLSS 4.5ではそれが6倍に向上し、よりスムーズな映像でゲームがプレイできる。

加えて、ダイナミックマルチフレーム生成にも対応。ダイナミックマルチフレーム生成は、ディスプレイのリフレッシュレートに合わせて、マルチフレーム生成の倍率を変動。グラフィックスの負荷が高いシーンでは、フレームの生成数を増やし、パフォーマンスの低下を防ぐ。

一方、負荷が軽いシーンでは、フレームの生成数を減らして、必要な計算のみを行える。それにより、画質が上がり、表現が向上する。ダイナミックフレーム生成では、240fpsと目標フレームレートを指定すると、フレーム生成数が調整され、安定したフレームレートでゲームがプレイできると語った。

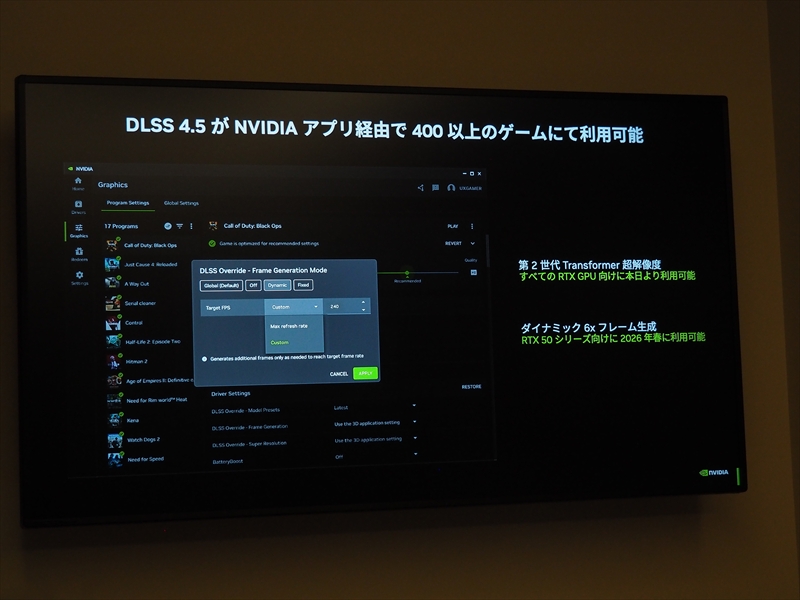

現在、GeForce RTXユーザーは、DLSS 4.5の超解像度の機能はNVIDIA Appから設定し、利用できる。6倍のマルチフレーム生成、ダイナミックフレーム生成は、2026年春から利用可能になる予定とのこと。

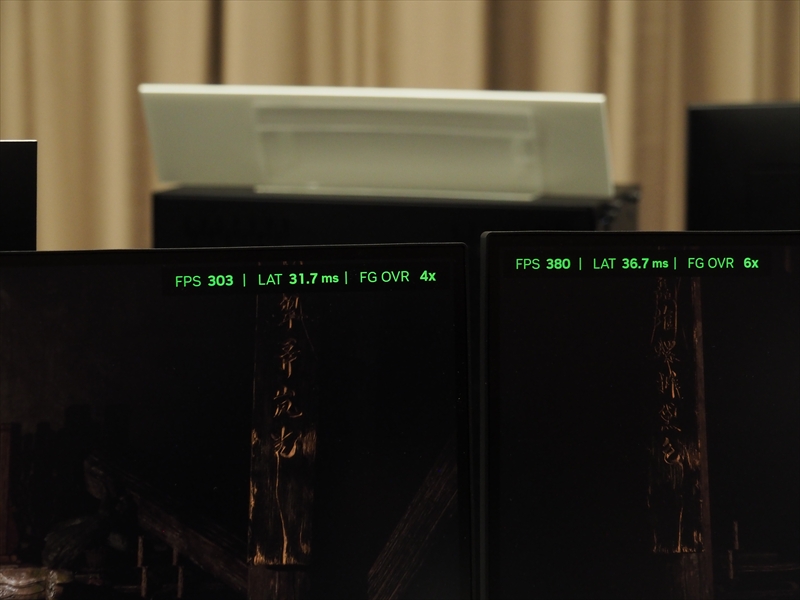

実際に会場では、『黒神話:悟空』を使ったDLSS 4とDLSS 4.5の比較デモが置かれていた。遠目だと分かり辛いが、たとえば香炉から漏れる光りの粒子が、DLSS 4だとあまり表現されていないが、DLSS 4.5だと明らかに増加し、細かな表現が向上している。

若干燃え盛る武器の炎から舞う火の粉もDLSS 4.5の方がより鮮明で、散る火の粉の量も増えているように見えた。また、フレームレートはDLSS 4だと300fps前後のところ、DLSS 4.5だと380fps前後まで増加していた。ただし、フレームタイムが5msほど増えているので、ゲームによってはその差の影響が気になるところだ。

NVIDIA GPU向けの無料アップデートでAI処理性能が向上

また、同社はDLSS以外のAI活用も行っている。同社は現在一般ユーザーや開発者の間で、PCでAIを動かすことの関心が高まっていると認識しているという。そのうえで、ローカル環境で処理を行うことで、プライバシーを完全に保てたり、ファイルに基づいた回答が得られる。

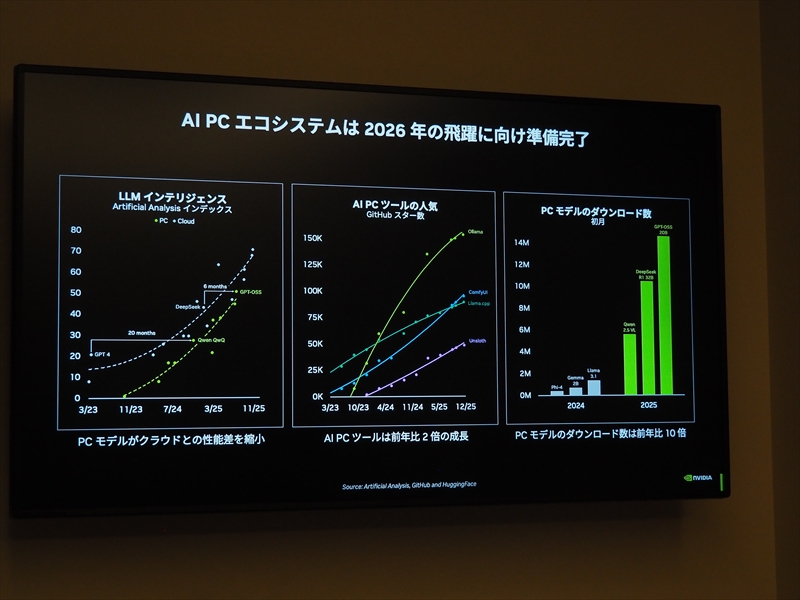

そして、通信やサービスのコストを気にせずに実行できるという大きなメリットがある。このAI・PCの普及を後押しする、3つの要素が整いつつあるとのこと。1つはPC向けモデルの進化。従来のPC向けの小規模言語モデルは、クラウド上のAIに対して性能が著しく劣っていた。

しかし現在、小型のPC向けの小規模言語モデルの性能は飛躍的に向上し、クラウドモデルとの差は、わずか半年ほどの差になるまで縮まっている。また、それらを扱うツールの進化も進んでいて、そうしたツールの人気がここ1年で2倍に向上。機能セットもクラウドとそん色ないレベルになっているという。

それに加え、コミュニティーも拡大。主要モデルのダウンロード数は、この1年で10倍に増加。エンスージアストや開発者の熱狂的な指示により、このエコシステムが盛り上がっている。

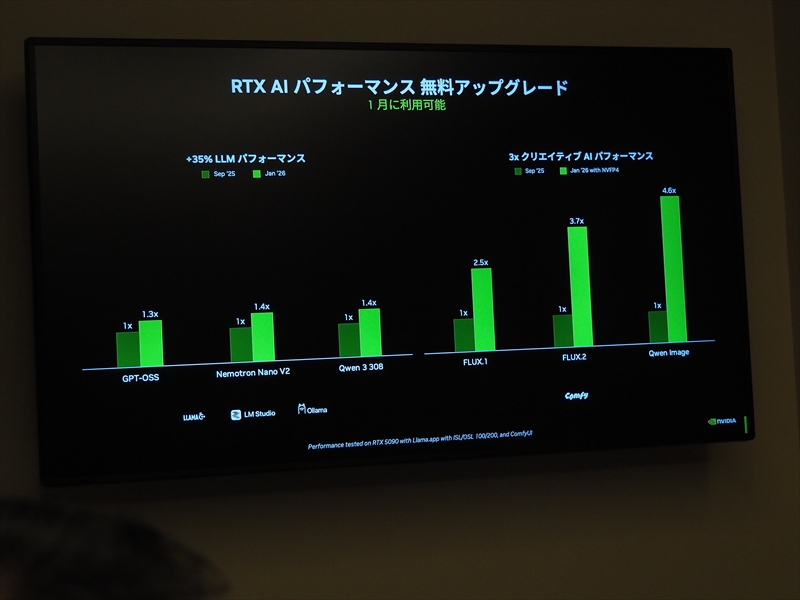

NVIDIAはそうした開発者やエンスージアストのために、オープンソースのコミュニティーや、アプリケーション開発者と連携し、NVIDIA GPUユーザー向けのパフォーマンスアップグレードを無料で提供している。たとえば、直近の四半期でローカルLLMを動かすツールの代表的なものであるLlama.cppは35%性能が向上。Ollamaは30%性能が向上を実現している。

さらに、今月もこうしたパフォーマンスアップグレードは行なわれており、LM Studioのパフォーマンスアップデートも提供される予定とのこと。

新たな量子化フォーマットのサポートで性能向上&VRAMを大幅に削減

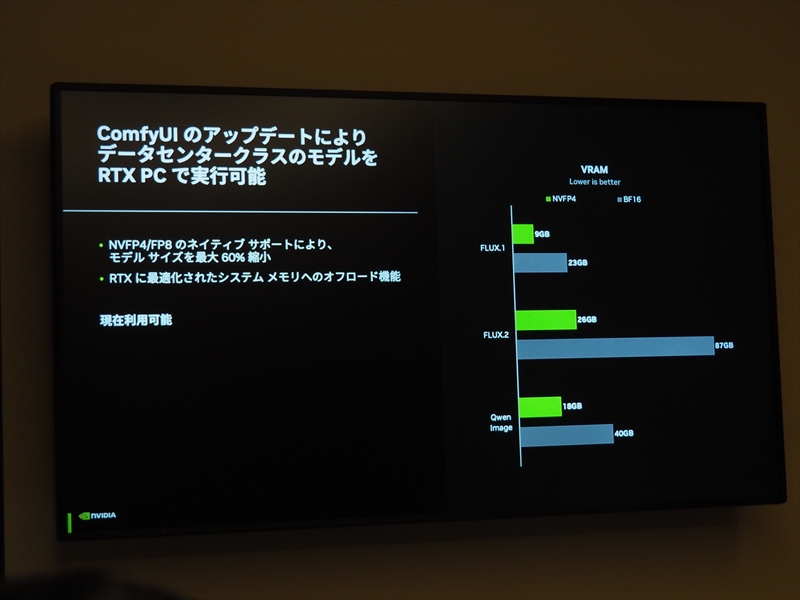

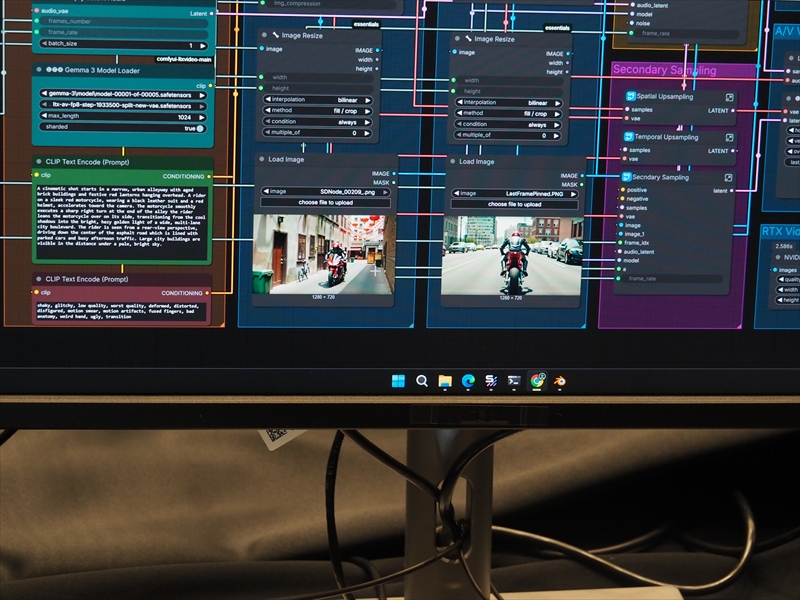

加えて、クリエイティブAI向けには、ComfyUIと共同で最適化を進めている。直近の四半期で性能を40%向上させ、コンテンツには4ビットの浮動小数点データフォーマットであるNVFP4、8ビットのNVFP8のネイティブサポートを追加している。

こうした最新の性能向上、新たな量子化フォーマットのサポートにより、従来の環境と比較してNVFP8で約2倍、NVFP4で約3倍という大幅なパフォーマンス向上が提供できるようになっているとのこと。

また、クリエイティブのAIの活用は、パフォーマンスだけでなくメモリも重要。AIモデルの巨大化が加速しているため、例えば最新の画像生成モデルFLUX.2では、ビデオメモリー(VRAM)の消費は90GB近くになり、一般的なコンシューマー向けのGPUのVRAMを遥かに超えてしまう。

そうした課題に対して、NVFP4やNVFP8による量子化が、パフォーマンス向上だけでなく、消費メモリの削減にも寄与する。NVFP4では約60%、NVFP8では約40%のメモリの削減が可能になるとのこと。さらに、NVIDIAはComfyUIと協力し、VRAMが不足した際にワークロードの一部をシステムメモリに回避させる、そうしたオフロード機能も実装している。

この機能はRTX GPU向けに最適化されているので、データセンターに非常に効率よく転送できるようになっているとしている。この2つのアプローチを組み合わせることで、FLUX.2といった大規模モデルが、PC上で実用的に動かせるようになっている。

そして、NVFP4、NVFP8形式のFLUX.2、FLUX.1、Qwen-ImageのCheckpoint(生成された画像の特徴を学習した内容を保存したデータ)が、すでに公開されているので、RTXユーザーであればすぐに試せるとのこと。

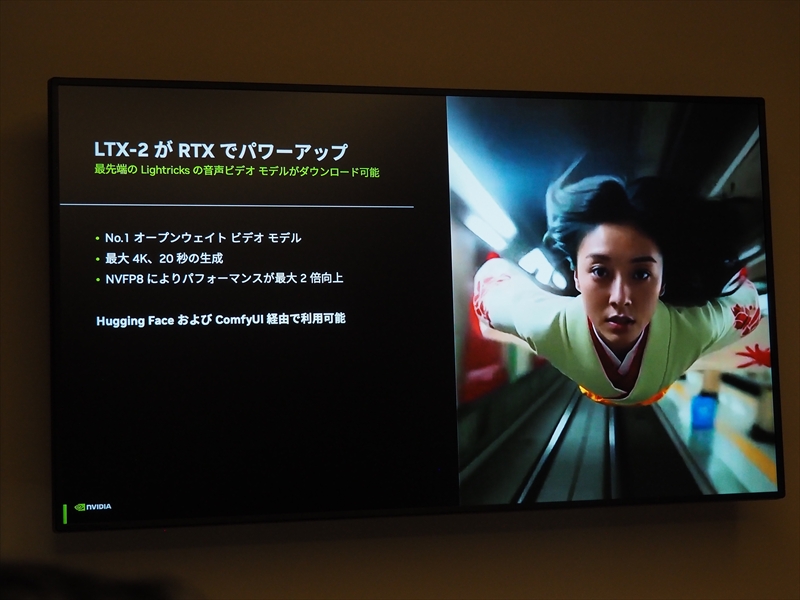

音声ビデオ生成も高速化&必要なVRAMを大幅に削減

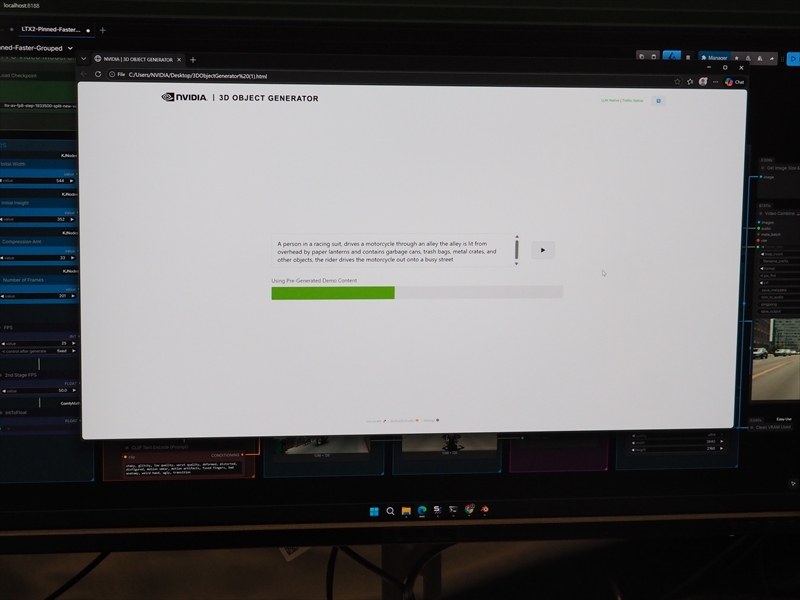

また、今年になって公開された音声を加えたビデオ生成の「LTX-2」というモデルもRTXに最適化されて登場し、大きな話題となり、人気になっているという。「LTX-2」は最大4Kの映像を50fps、あるいわ最長で20秒間のビデオを生成できる。

このモデルも非常に大きく、このモデル全体を読み込むとVRAMが70GB必要だったり、パイプライン(一連のプロセス)を一部だけ読み込んだ場合でも50GBのVRAMが必要になる。しかし、NVFP8の量子化モデルを採用することで、必要なメモリを約26GBまで削減できるとのこと。

さらに、メモリのオフロード機能を組み合わせることで、16GB以上のVRAMを搭載したビデオカードであれば、ローカルのPCで動かせるようになるという。パフォーマンスの面でも、RTX 5090を使ってNVFP8の量子化モデルを動かすと最大で2倍の高速が実現。

数秒の短いビデオであれば30秒程度、そして10秒のビデオクリップでも、約3分くらいと驚異的なスピードで生成できるようになっている。

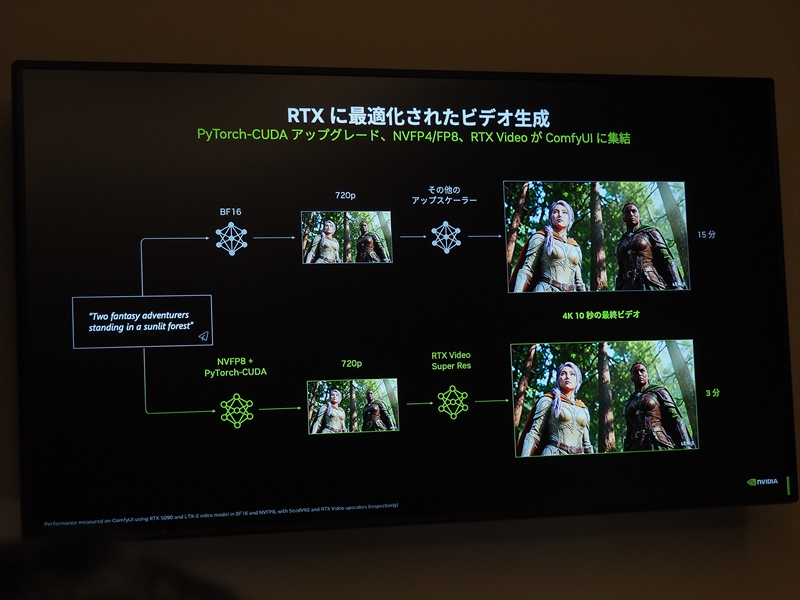

アップスケーリングも加え、ビデオ生成が超高速化!

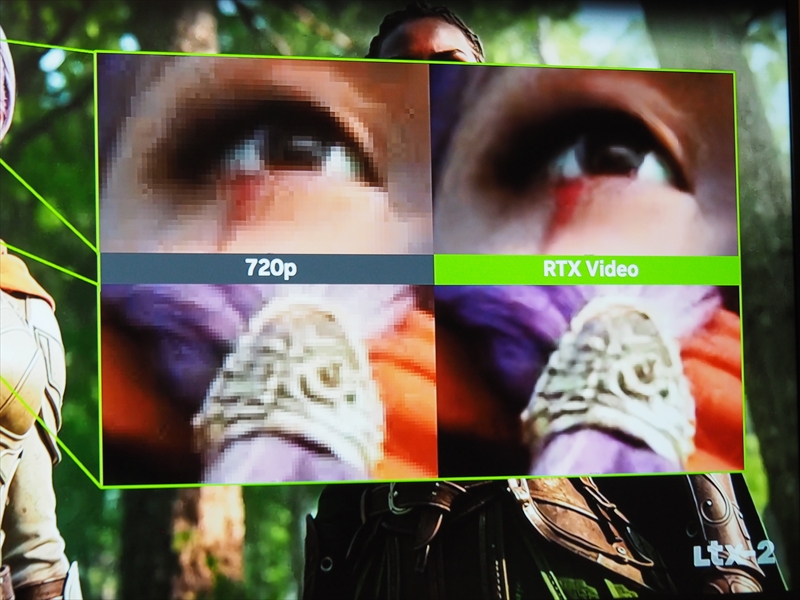

また、こうした新しいビデ生成モデルが登場する中で、ビデオのアップスケーラーの注目も高まっているという。なぜかというと、ビデオの生成モデルが4K向けに最適化されていなかったり、4K映像を生成するには膨大な時間、そして大きなメモリが必要になるためだという。

そのため、多くのユーザーが480pまたは720pといった低解像度で生成したビデオを、その後にアップスケールして、4Kなどの高解像度にアップスケールしている。しかし、従来のアップスケールでは、たとえば10秒の映像をアップスケールするのに10分以上かかっていた。

そこで、NVIDIAはComfyUIと協力し、NVIDIAのリアルタイムビデオアップスケーラーであるRTX Videoを、ComfyUIに直接統合。これにより、高品質な画像を維持しながら、アップスケールに要する時間を大きく削減でき、ビデオ生成のワークフローにこれまで以上のスピードと効率性をもたらせるとアピールした。

高性能でメモリ消費の少ない量子化モデル、CUDAの最適化、リアルタイムのビデオアップスケーラーを組み合わせることで、RTX GPUを搭載したPCに最適化されたビデオ生成パイプラインを構築できるとしている。たとえば、LTX-2を使った4K10秒のビデオ生成が、従来だと15分くらいだったところ、3分ほどと大きく短縮できるとのこと。

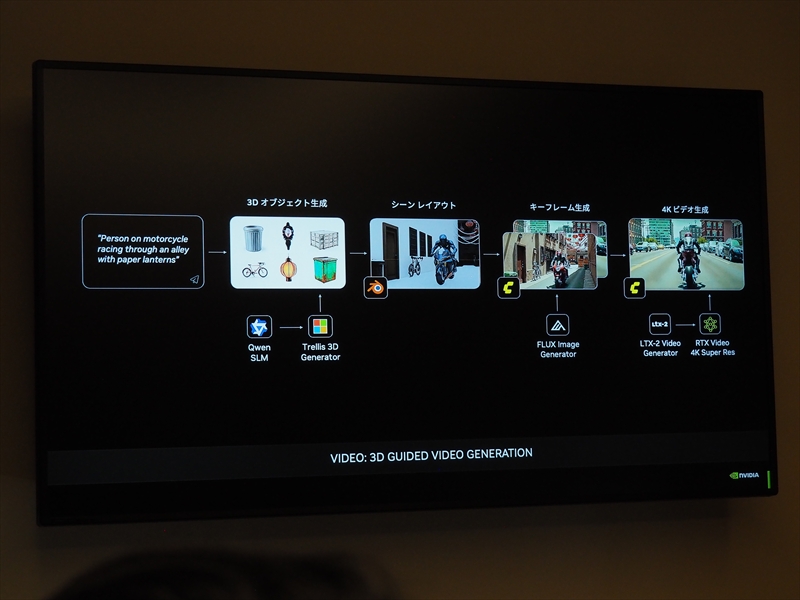

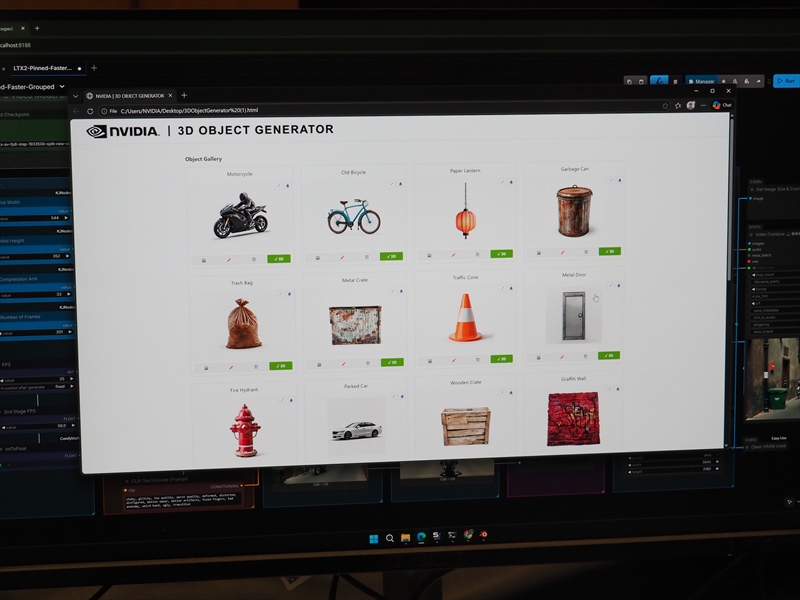

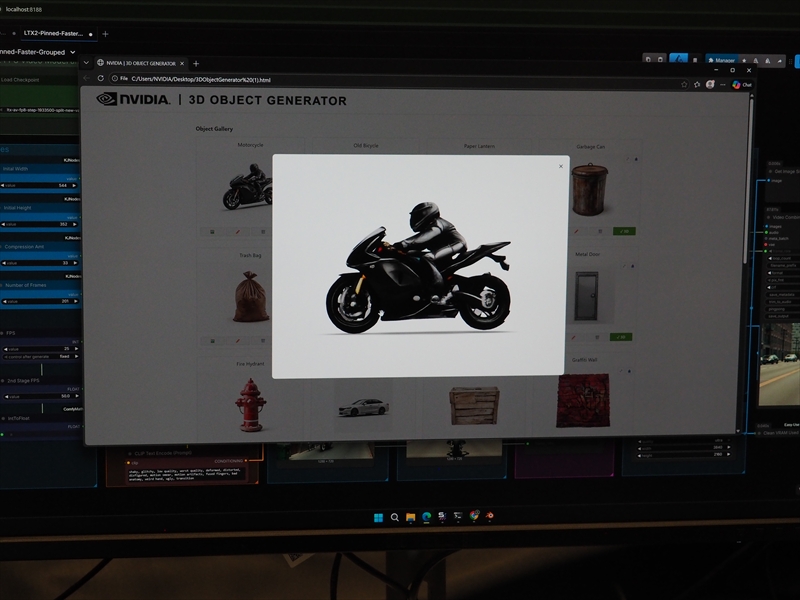

さらに、このパイプラインに3Dアプリを組み合わせることで、完全に制御可能なビデオ生成パイプラインが構築できるとのこと。まず、ストーリーのアイディアをテキストで書き出し、そのテキストから3DのアセットをAIが生成。生成されたアセットを3DアプリのBlenderで読み込んで、シーンをレイアウト。

そして、FLUXを使ってAIで作られた3D CGを基に高精細なキーフレーム画像を生成。LTX-2を使ってキーフレーム同士をつなぐビデオを生成し、それをRTX Videoを使って4Kの高解像度にアップスケールすることができるとのこと。このパイプラインにより、従来は数時間、何日もかかっていた作業が、わずか数分でできるようになるとしている。

実施にデモでは、LTX-2を使ったビデオ生成が見れた。テキストから10数秒で3Dアセットがいくつか提示され、それを背景画像と合わせてシーンを作って、ビデオの最初と最後の画像をキーフレームとして指定。わずか数分でライダーがバイクに走らせ路地から大通りに出て走っていく映像が作られていた。

PCの中から必要なファイルを探す

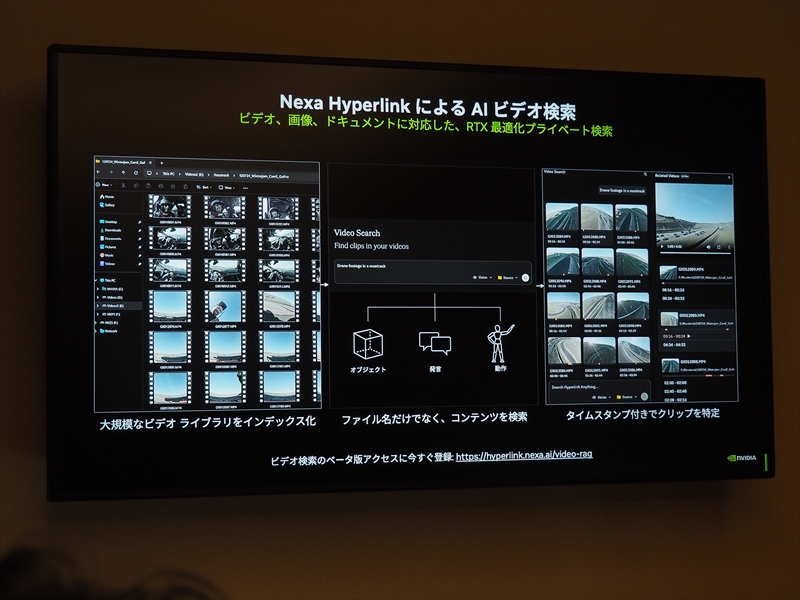

もう1つクリエイター向けのAIツールとして紹介されたのは、Nexaの「Hyperlink」だ。仕事をしている際に、PCの中から必要なファイルを探すのは、割と大変だ。Windows PCのエクスプローラーでファイルを検索する際は、ファイル名など限られたメタデータからしか検索できない。

しかし、「Hyperlink」はストレージ内のインデックスを生成し、生成AIを用いて検索する。この検索作業がRTX GPUによって高速化される。CES2026では、この検索対象がドキュメント、文章、画像だけでなく、ビデオ(動画)も加わったと明らかになった。

動画はファイル名だけでなく、動画内の特定の発言、アクションからも検索できるようになっているという。また、検索結果も整理されて表示される。さらに、該当箇所に直接アクセスできるタイムスタンプも提供される。

こうした機能は、素材を探すことに追われる動画編集者にとって大きな時間短縮になるとしている。ちなみに「Hyperlink」は、ベータ版が今月リリース予定となっている。現在公式のウェブサイトでは、ベータ版へのサインアップが開始されているとのこと。

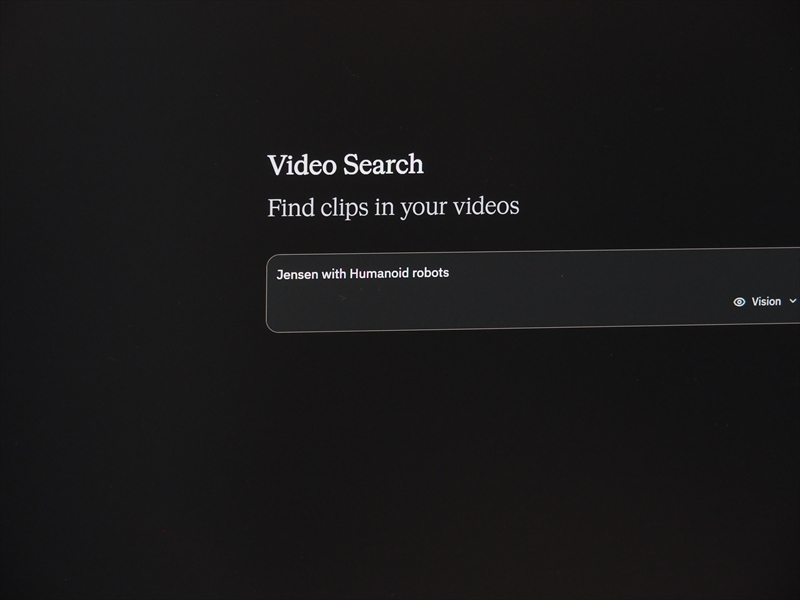

デモでは、NVIDIAのCEO ジェンスン・フアン氏と人型ロボットと検索。PC内にあるジェンスン・フアン氏が、ロボットと一緒にいる映像がいくつか検索されて表示された。記者からジェンスン・フアン氏は、有名人なのでネットに情報が出回っているが、それらを参照しているのか、といった質問が出たが、ローカルの情報のみで検索されているという。

イベントでは、ジェンスン・フアン氏が登壇する際に、MCから呼び込まれることもあるので、そうした音声からジェンスン・フアン氏だと認識しているのかもしれないが、それでは名前を呼んでいる音声がなければ、特定の人物を検索できないのかなどが気になる。

髭や髪の色、性別、体型など、そうした要素の指定でどれぐらいの精度があるのかなども、実際に試してみないと分からない。同社は動画制作者の素材検索に好適と紹介しているが、実際に一般ユーザーであっても、学校で配布された資料のデータや、友達との写真など、あらゆる検索に活用できるのだとしたら、使用者の恩恵は大きそうだ。

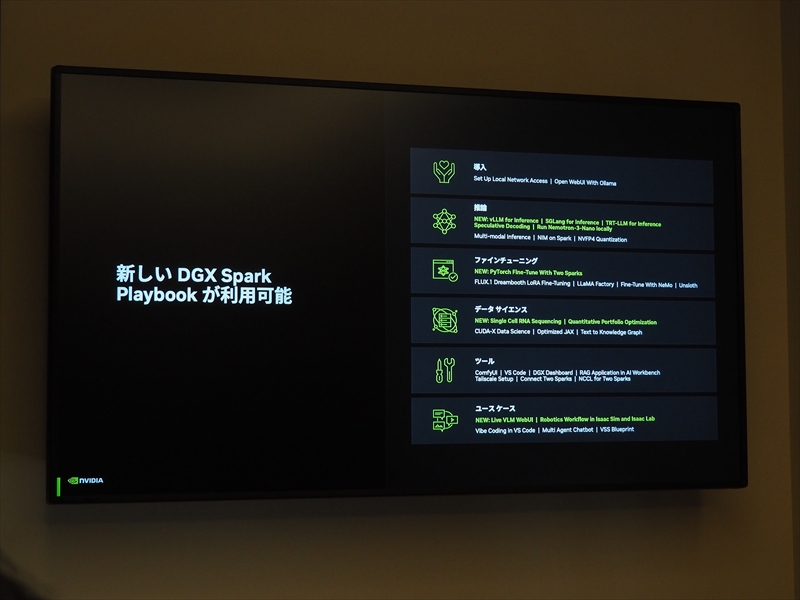

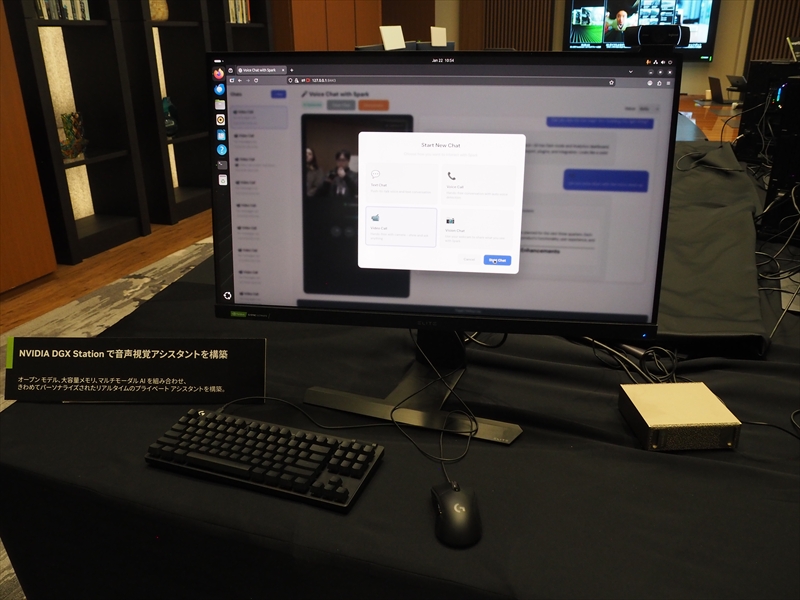

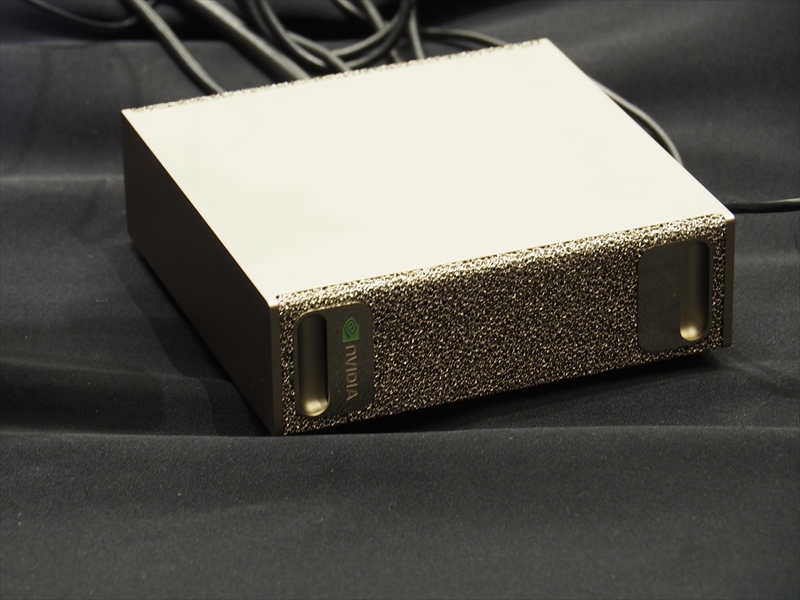

超小型なスパコンDGX Sparkもアップデート!

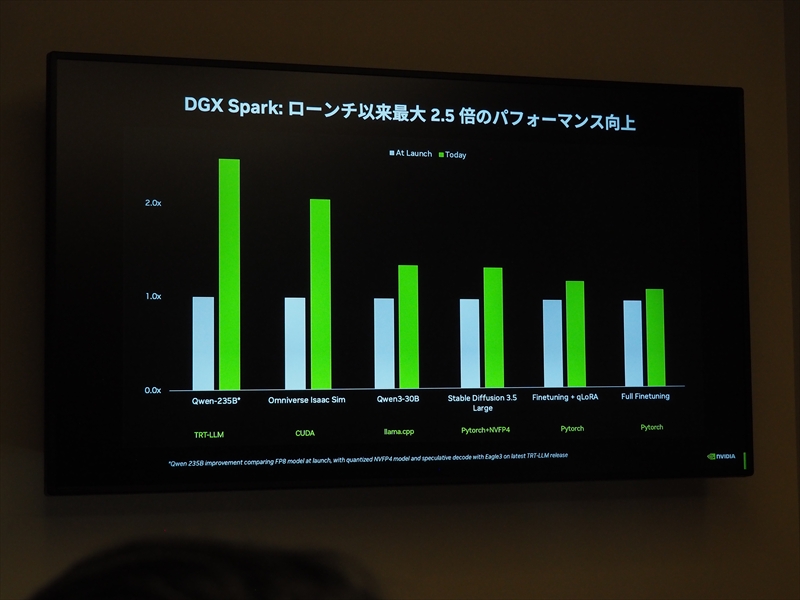

また、昨年10月に発表された超小型なスーパーコンピューター「NVIDIA DGX Spark」(以下、DGX Spark)のアップデートの紹介もあった。たとえば、大規模言語化モデル「Qwen3-235B」は、NVFP4の量子化サポート、TensorRT-LLM(大規模モデルを実行する推論エンジン)の最新版に搭載されているEagle3投機的デコーディングを採用することで、パフォーマンスを2.5倍に向上。

ほかにもロボティクスシミュレーションアプリ「Isaac Sim」では、最新のCUDAドライバーの最適化によって、グラフィックスと計算の相互運用性を強化することで、2倍のパフォーマンスの向上を実現している。

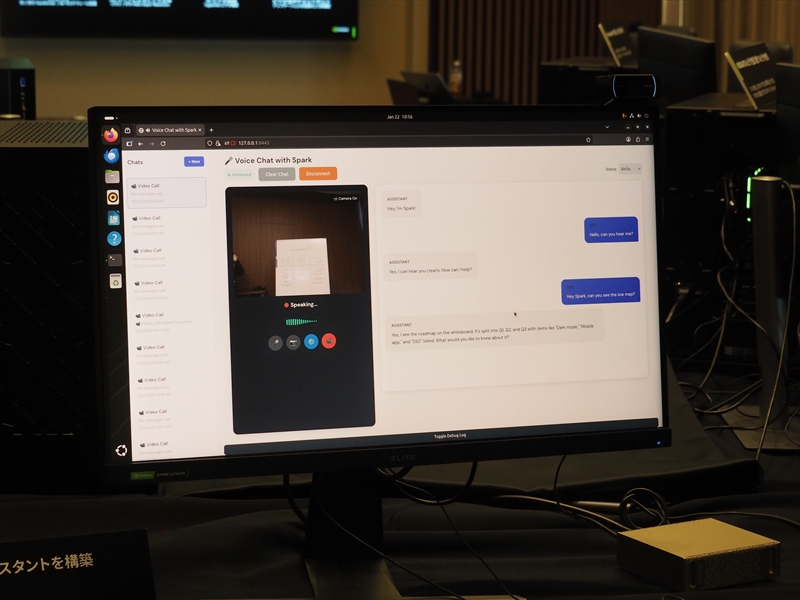

デモでは、チャットボットを使った会話による、リアルタイムアシスタント機能が紹介された。音声認識、LLM、音声合成、そうしたたくさんのAIモデルが同時に動き、遅延なくリアルタイムに音声での質問にチャットが音声で返答していた。

また、カメラもあるため、カメラに写っているホワイトボードのテキストを認識し、それについての質問にも遅延がほぼなく回答してくれていた。

コメント